Lançamento do Curso Big Data Analytics com Hadoop pela 4Linux

A 4Linux anuncia nesta data o lançamento do curso Big Data Analytics com Hadoop , o primeiro curso na área de big data da 4Linux.

O Hadoop é um projeto de software de código aberto mantido pelo Fundação Apache usado para processar de modo eficiente grandes quantidades de dados.

“Os projetos da Fundação Apache fazem muito sucesso e são de qualidade elevada e com o Hadoop isso não é diferente. O mercado pediu, e como o Hadoop é um software open source a 4Linux não poderia deixar de atender esta demanda do mercado.” explica Rodolfo Gobbi, Diretor Geral da 4Linux.

Big Data é o termo para descrever o imenso volume de dados que podem afetar os negócios no dia a dia. Além de uma infraestrutura robusta que trata este elevado volume de dados, também são necessários analistas e estatísticos que analisam os dados e fazem projeções para a obtenção de insights que levam a melhores decisões e direções estratégicas de negócio.

“Quando falamos de BigData, há 3 áreas de atuação: infraestrutura, analytics e estatística. Este novo curso da 4Linux é focado na montagem da infraestrutura necessária para uma empresa estruturar sua área de BigData. O foco do curso não são as áreas de analytics e estatística”, explica Gabriela Dias, Diretora de Operações da 4Linux.

O Hadoop não é um software único mas sim um eco-sistema composto de vários softwares cada um com uma finalidade diferente – que atuando em conjunto – formam a mais popular sistema de infraestrutura de BigData de todo o mundo.

” Os cursos oferecidos no mercado ensinam o básico de uma infra hadoop. Nós optamos por ir a fundo e mostrar vários elementos do eco-sistema Hadoop para ensiná-lo da fato a montar uma infraestrutura de BigData. Além de aprender a instalar e gerenciar um Cluster Hadoop,o aluno também vai ver no cursos outros softwares do eco-sistema Hadoop como: HBase/Zookeeper, Sqoop/Flume, Hive, Pig, Spark, Hue, Zeppelin, Ambari.” explica Roberto Farias, um dos autores do curso.

About author

Você pode gostar também

Guia para usar a DeepSeek

Como Usar a DeepSeek: Guia para Usuários e Desenvolvedores A DeepSeek não é apenas um modelo de IA revolucionário, mas também uma ferramenta altamente acessível para usuários comuns e desenvolvedores.

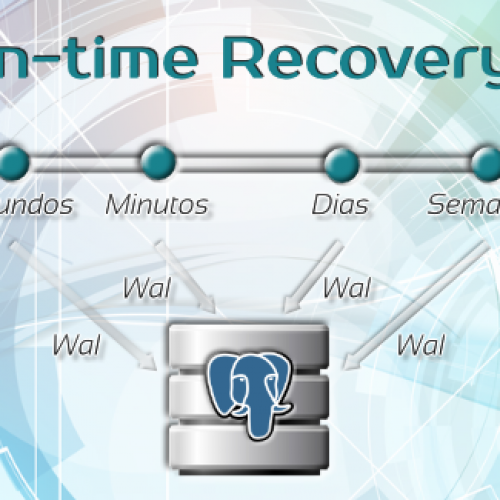

Como implementar e recuperar backups PITR no PostgreSQL

Neste artigo você aprenderá: como implementar um simples sistema de replicação através dos xlog. como recuperar o seu banco PostgreSQL em qualquer ponto no tempo. Sobre backups PITR Quando

Por que Python é a linguagem preferida para análise de dados?

É inegável que o uso do Python de maneira geral está crescendo! No entanto, o uso da programação Python está crescendo não só para desenvolvimento de aplicações, testes e automações